|

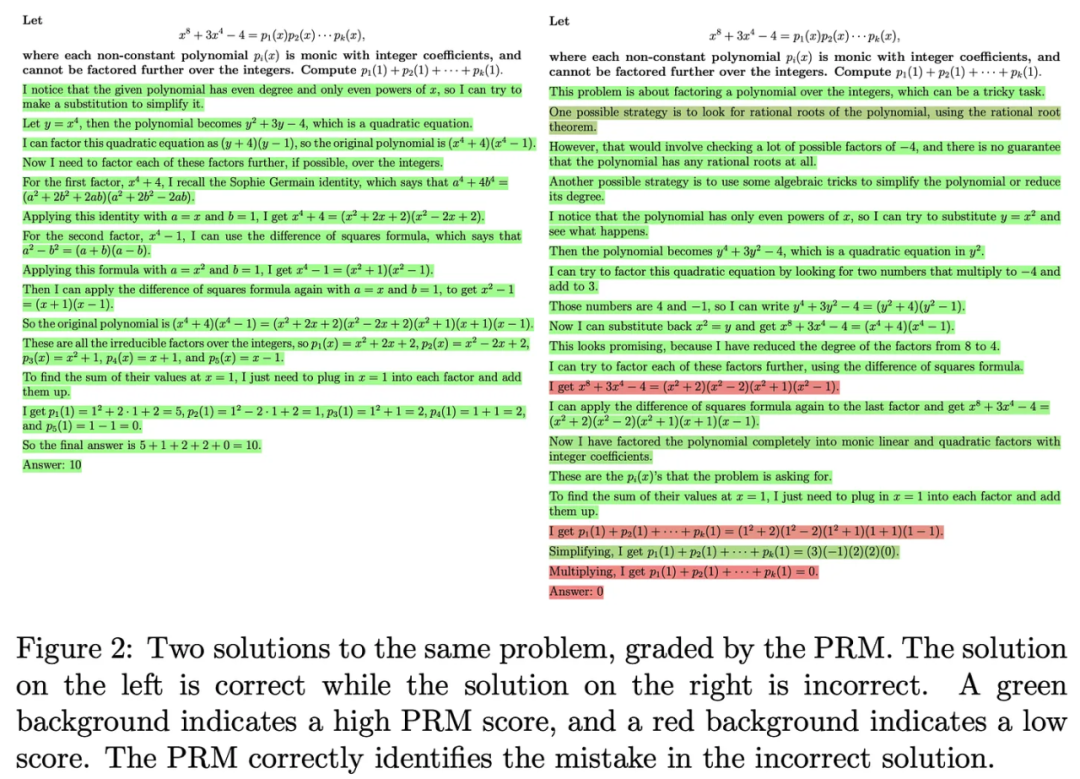

?最近这些天,OpenAI 的神秘项目 Q* 引发了许多人的关注,因为这个项目可能意味着实现通用人工智能(AGI)的关键突破。这篇文章里,作者就对 Q* 做了猜测与解读,一起来看看本文的分享。  ToT 的创新之处在于将推理步骤分块,并促使模型创建新的推理步骤。这应该是第一种用于提高推理性能的 “递归 “提示技术,与人工智能安全所关注的递归自我改进模型非常接近。 对于推理树,可以采用不同的方法对每个顶点(节点)进行评分,或对最终路径进行采样。它可以基于诸如到最一致答案的最短路径,也可以基于需要外部反馈的复杂路径,这又把我们引向了 RLHF 的方向。 ToT 论文地址:https://arxiv.org/abs/2305.10601 四、细粒度奖励:过程奖励模型 PRM迄今为止,大多数 RLHF 的方法都是让语言模型的整个响应得到一个相关的分数。对于任何具有 RL 背景的人来说,这都是令人失望的,因为它限制了 RL 方法将文本的每个子部分的价值联系起来的能力。 有人指出,未来由于需要有人类或一些提示源在循环中,这种多步骤优化将在多个对话回合的层面上进行,但这比较牵强。这可以很容易地扩展到自我对弈式的对话中,但很难赋予 LLMs 目标,使其转化为持续改进的自我对弈动态。我们想让 LLMs 做的大多数事情都是重复性任务,而不会像围棋那样对性能设置近乎无限的上限。 另一方面,有一种 LLM 用例可以很自然地抽象为文本块:逐步推理,数学问题就是最好的例子。 过程奖励模型(PRMs)是 Nathan 在过去 6 个月里从 RLHF 朋友那里听到的一个非公开话题。关于这些模型的文献很多,但关于如何在 RL 中使用这些模型的文献却很少。PRM 的核心理念是为每个推理步骤而不是完整的信息分配分数。下面是 OpenAI 论文《让我们一步步验证》( Let’s Verify Step by Step)中的一个例子: 图 2 为同一个问题的两种解决方案,左边答案是正确的,右边的答案错误。绿色背景表示 PRM 得分高,红色背景表示 PRM 得分低。PRM 可以正确识别错误解决方案中的错误。对于错误的解决方案,两种方法都揭示出至少存在一个错误,但过程监督还揭示了该错误的确切位置。  而他们使用的有趣的反馈界面(将被人工智能取代),却很有启发性:  这样就可以通过对最大平均奖励或其他指标进行采样,而不是仅仅依靠一个分数(标准 RM 在该文献中被称为结果 RM),对推理问题的生成进行更精细的调整。 使用 “N最优采样”(Best-of-N sampling),即生成一系列次数,并使用奖励模型得分最高的一次(这是 “拒绝采样”(Rejection Sampling)的推理方式之一,在 Llama 2 中广为流传),PRM 在推理任务中的表现优于标准 RM。 迄今为止,大多数 PRMs 资源只是展示了如何在推理时使用它们。当这种信号针对训练进行优化时,才能发挥真正的威力。要创建最丰富的优化设置,必须能够生成多种推理路径,用于评分和学习。这就是思维树的作用所在。ToT 的提示为人们提供了多样性,可以通过访问 PRM 来学习利用这种多样性。 此外,还有一种流行的公开数学模型被记录为使用 PRMs 进行训练:Wizard-LM-Math。同时,OpenAI 在今年早些时候发布了用于训练 PRM 的《逐步验证》(Verify Step by Step)论文中的细粒度奖励标签。 五、回头来看 Q* 与模型推理Q* 似乎是在使用 PRM 对思维树推理数据进行评分,然后使用离线 RL 对其进行优化。这看起来与现有的 RLHF 工具并无太大区别,后者使用的是 DPO 或 ILQL 等离线算法,无需在训练期间从 LLM 中生成。RL 算法看到的 “轨迹 “是推理步骤的序列,因此我们最终是在以多步骤方式而非上下文绑定的方式进行 RLHF。 由于有听闻已经表明 OpenAI 正在使用离线 RL 进行 RLHF,这或许并不是一个大的飞跃。这种方法的复杂之处在于:收集正确的提示、建立模型以生成出色的推理步骤,以及最重要的一点:对数以万计的完成情况进行准确评分。 最后一步就是传闻中的 “庞大计算资源 “所在:用人工智能代替人类给每个步骤打分。合成数据才是王道,用树状而非单宽路径(通过思维链)在后面给出越来越多的选项,从而得出正确答案。 据悉有一家或几家大型科技公司(谷歌、Anthropic、Cohere 等)正在通过过程监督或类似 RLAIF 的方法创建一个预训练大小的数据集,这将快速耗费数万个 GPU 小时。 在这一领域,公开可用模型的差距令人担忧。总结来看,虽然核心理念似乎很清晰,但实施起来却很难。所有对 ToT 和 PRM 的评估都是针对数学等推理问题的,而这正是所有新闻报道所说的这种泄露方法的目的所在。即使它不是 Q*,也会是一个有趣的实验。 对于超大规模人工智能反馈的数据与未来: 大模型训练过程中数据不足,合成数据是扩大数据集的方式之一。在短期内,我们是可以利用它创建一些有用的数据。 然而,目前尚不清楚的是它的扩展程度。 它是否能完全取代互联网规模的数据? Let’sverify step by step. 参考材料: Nathan 观点:https://www.interconnects.ai/p/q-star?lli=1&utm_source=profile&utm_medium=reader2 Jim 观点:https://x.com/DrJimFan/status/1728100123862004105?s=20 PRM 参考论文:

编辑:Vela 来源公众号:深思SenseAI;关注全球 AI 前沿,走进科技创业公司,提供产业多维深思。 本文由人人都是产品经理合作媒体 @深思SenseAI 授权发布,未经许可,禁止转载。 题图来自 Unsplash,基于CC0协议 该文观点仅代表作者本人,人人都是产品经理平台仅提供信息存储空间服务。 |